BTC/HKD-3.36%

BTC/HKD-3.36% ETH/HKD-3.08%

ETH/HKD-3.08% LTC/HKD-2.04%

LTC/HKD-2.04% ADA/HKD-4.52%

ADA/HKD-4.52% SOL/HKD-5.46%

SOL/HKD-5.46% XRP/HKD-5.59%

XRP/HKD-5.59%

作者|劉大一恒、齊煒禎、晏宇、宮葉云、段楠、周明

編者按:微軟亞洲研究院提出新的預訓練模型ProphetNet,提出了一種新的自監督學習目標——同時預測多個未來字符,在序列到序列的多個自然語言生成任務都取得了優異性能。

大規模預訓練語言模型在自然語言理解和自然語言生成中都取得了突破性成果。這些模型通常使用特殊的自監督學習目標先在大規模無標記語料中進行預訓練,然后在下游任務上微調。

傳統自回歸語言模型通過估計文本語料概率分布被廣泛用于文本建模,序列到序列的建模,以及預訓練語言模型中。這類模型通常使用teacher-forcing的方法訓練,即每一時刻通過給定之前時刻的所有字符以預測下一個時刻的字符。然而,這種方式可能會讓模型偏向于依賴最近的字符,而非通過捕捉長依賴的信息去預測下一個字符。有如以下原因:局部的關系,如兩元字符的組合,往往比長依賴更強烈;Teacher-forcing每一時刻只考慮對下一個字符的預測,并未顯式地讓模型學習對其他未來字符的建模和規劃。最終可能導致模型對局部字符組合的學習過擬合,而對全局的一致性和長依賴欠擬合。尤其是當模型通過貪心解碼的方式生成序列時,序列往往傾向于維持局部的一致性而忽略有意義的全局結構。

穆迪:私人資本和另類投資中存在代幣化機遇:金色財經報道,穆迪公司的Rajeev Bamra強調了為追求更高回報而向非流動性資產轉移的需求,而代幣化是其中的一個推動因素。德國資產管理公司Union Investment的Christoph Hock說,Z世代渴望有更多的投資選擇。

花旗證券服務公司本周早些時候發布了一項調查,探討了穆迪的觀點。它強調了賣方與機構投資者之間的不匹配,賣方認為上市股票和公共債務的代幣化會帶來好處,而機構投資者則認為代幣化對私人股票和債務有吸引力。[2023/8/25 10:03:08]

ProphetNet

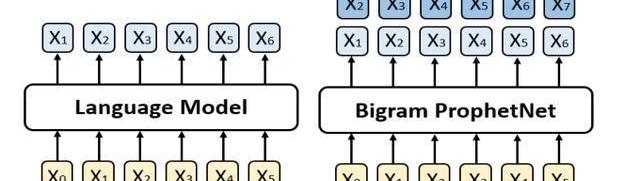

針對上述問題,我們提出了一個新的seq2seq預訓練模型,我們稱之為ProphetNet。該模型帶有一個新穎的自監督學習目標函數,即預測未來的N元組。與傳統seq2seq的Teacher-forcing每一時刻只預測下一個字符不同,ProphetNet每一時刻將學習去同時預測未來的N個字符。如圖1所示:

DCG旗下加密交易所Luno高管辭職,DCG旗下部分公司宣布關閉新加坡業務:金色財經報道,DCG旗下加密交易所Luno負責企業發展和國際業務的副總裁Vijay Ayyar近日表示,他已從Luno公司辭職,此前Ayyar已在Luno工作了7年之久。

Ayyar的辦公室曾位于新加坡。此前報道,DCG旗下的部分公司最近宣布關閉其在新加坡的業務。Ayyar則表示,其辭職與DCG旗下公司退出新加坡無關。Luno發言人表示,“Ayyar的角色是全球性的,與我們關閉新加坡公司的任何相關事宜都沒有關系。”

目前,Luno正在進行重大重組。(CNBC)[2023/5/2 14:38:56]

圖1:左邊是傳統的語言模型,每一時刻預測下一時刻的字符。右邊是Bigram形式下的ProphetNet,每一時刻同時預測未來的兩個字符。

預測未來N元組這一自監督學習目標在訓練過程中顯式地鼓勵模型在預測下一個字符時考慮未來更遠的字符,做到對未來字符的規劃,以防止模型對強局部相關過擬合。

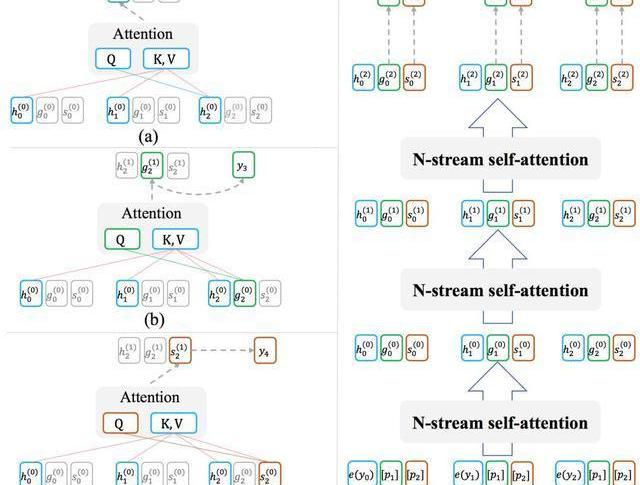

ProphetNet基于Transformer的seq2seq架構,其設計有兩個目標:1.模型能夠以高效的方式在訓練過程中完成每時刻同時預測未來的N個字符;2.模型可以靈活地轉換為傳統的seq2seq架構,以在推理或微調階段兼容現有的方法和任務。為此,我們受XLNet中Two-streamselfattention的啟發,提出了用于模型decoder端的N-streamself-attention機制。圖2展示了bigram形式下的N-streamself-attention樣例。

數據:第一季度流入英國數字資產公司的風投資本較上年同期下降94%:4月2日消息,據彭博社援引PitchBook數據報道,第一季度流入英國數字資產公司的風險資本投資較上年同期下降94%至5500萬美元。相比之下,歐洲其他地區的增長率約為31%。

據悉,自2月以來,包括匯豐銀行和Natwest在內的主要銀行通過進一步限制英國客戶可以轉移到數字資產交易所的金額而成為頭條新聞,這對飽受打擊的行業造成了新的打擊。[2023/4/3 13:41:04]

除了原始的multi-headself-attention之外,N-streamself-attention包含了額外的N個predictingstreamself-attention,用于分別預測第n個未來時刻的字符所示。每一個predictingstream與mainstream共享參數,我們可以隨時關閉predictingstream以讓模型轉換回傳統seq2seq的模式。

Lens Protocol Profiles地板價漲至100 USDC:2月11日消息,據OpenSea頁面信息,Web3社交協議Lens Protocol生態NFT Lens Protocol Profiles當前地板價漲至100 USDC。過去24小時累計成交1679筆,增幅達16%。[2023/2/11 12:01:06]

圖2:(a)為mainstreamself-attention;(b)為1-stpredictingstreamself-attention;(c)為2-ndpredictingstreamself-attention;(d)展示了n-streamself-attention的輸入輸出及流程。

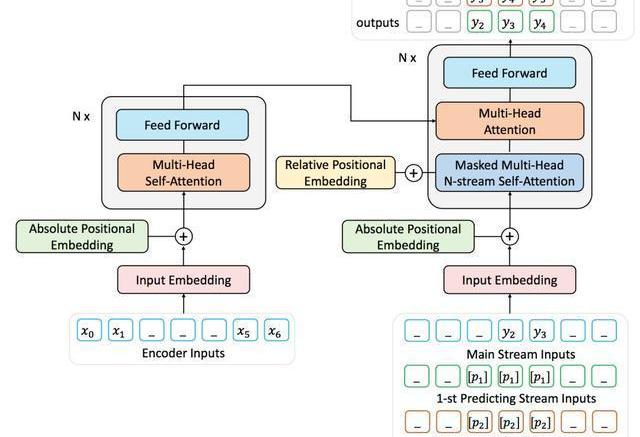

由于難以獲取到大量帶標記的序列對數據,我們用去噪的自編碼任務通過大量無標記文本預訓練ProphetNet。去噪的自編碼任務旨在輸入被噪音函數破壞后的序列,讓模型學習去復原原始序列。該任務被廣泛應于seq2seq模型的預訓練中,如MASS、BART、T5等。本文中使用MASS的預訓練方式,通過引入提出的predictingn-stream自監督學習目標函數預訓練ProphetNet。我們以bigram形式的ProphetNet為例,整個流程如圖3所示:

Elon Musk:Twitter每天虧損超400萬美元:11月5日消息,Elon Musk在社交媒體上披露,Twitter每天虧損超過400萬美元,因此裁員別無選擇,不過每個裁掉的人都獲得了三個月的遣散費,比美國法律要求的多50%。

此外,Elon Musk已將自己的Twitter個人簽名改成了“Twitter投訴熱線接線員”(Twitter Complaint Hotline Operator),同時還明確表示,Twitter對內容的堅定承諾絕對沒有改變,而且仇恨言論已經下降到低于之前規范的水平。[2022/11/5 12:19:00]

圖3:二元形式下的Prophet整體框架圖

實驗結果

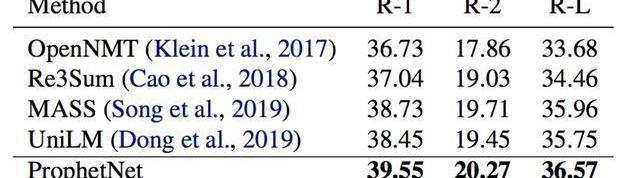

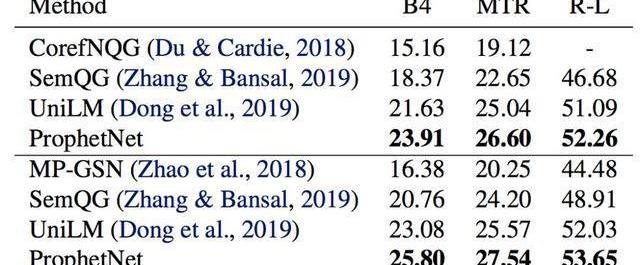

我們使用兩個規模的語料數據訓練ProphetNet。ProphetNet包含12層的encoder和12層的decoder,隱層大小為1024。先在BERT所使用的BookCorpus+Wikipedia的數據上預訓練模型,將模型在Textsummarization和Questiongeneration兩個NLG任務上的三個數據集微調并評估模型性能。與使用同等規模數據的預訓練模型相比,ProphetNet在CNN/DailyMail、Gigaword和SQuAD1.1questiongeneration數據集上都取得了最高的性能,如表1-3所示。

表1:CNN/DailyMail測試集結果

表2:Gigaword測試集結果

表3:SQuAD1.1測試集結果SQuAD1.1交換驗證測試集結果

除了使用16GB的語料訓練模型,我們也進行了更大規模的預訓練實驗。該實驗中,我們使用了160GB的語料預訓練ProphetNet。我們展示了預訓練14個epoch后的ProphetNet在CNN/DailyMail和Gigaword兩個任務上微調和測試的結果。如表4所示。需要注意的是,在相同大小的訓練數據下,我們模型的預訓練epoch僅約為BART的三分之一。我們模型的訓練數據使用量僅約為T5和PEGASUSLARGE的五分之一,約為PEGASUSLARGE的二十分之一。盡管如此,我們的模型仍然在CNN/DailyMail上取得了最高的ROUGE-1和ROUGE-LF1scores。并在Gigaword上實現了新的state-of-the-art性能。

表4:模型經大規模語料預訓練后在CNN/DailyMail和Gigaword測試集的結果

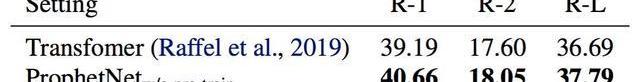

為了進一步探索ProphetNet的性能,我們在不預訓練的情況下比較了ProphetNet和Transformer在CNN/DailyMail上的性能。實驗結果如表5所示,ProphetNet在該任務上超越了同等參數量的Transformer。

表5:模型不經過預訓練在CNN/DailyMail驗證集結果

總結

本文介紹了微軟亞洲研究院在序列到序列模型預訓練的一個工作:ProphetNet,該模型提出了一種新的自監督學習目標,在同一時刻同時預測多個未來字符。并通過提出的N-streamself-attention機制高效地實現了模型在該目標下的訓練。實驗表明,該模型在序列到序列的多個自然語言生成任務都取得了不錯的性能。我們將在之后嘗試使用更大規模的模型架構和語料進行預訓練,并進一步深入地探索該機制。

論文鏈接:https://arxiv.org/pdf/2001.04063.pdf

原力計劃

《原力計劃-學習力挑戰》正式開始!即日起至3月21日,千萬流量支持原創作者!更有專屬等你來挑戰

Python數據清理終極指南口罩檢測識別率驚人,這個Python項目開源了談論新型冠狀病、比特幣、蘋果公司……沃倫巴菲特受訪中的18個金句,值得一看!天貓超市回應大數據殺熟;華為MateXs被熱炒至6萬元;Elasticsearch7.6.1發布一張圖對比阿里、騰訊復工的區別不看就虧系列!這里有完整的Hadoop集群搭建教程,和最易懂的Hadoop概念!|附代碼

來源:Chinamoney 內容提要 從全球范圍看,在一種貨幣開始成為國際性貨幣的過程中,相應的跨境清算結算機制必不可少.

1900/1/1 0:00:00如今,美國和伊朗之間緊張局勢的風險有所緩解,黃金價格似乎立即做出了反應。隨著投資者似乎轉向風險更高的資產,黃金價格目前已從2013年以來的近期高點回落.

1900/1/1 0:00:00來到幣圈的人都有一個暴富夢,其實暴富的概率真的極小,這么多坑,一不小心就要掉進去一個,這比創業成功的難度不會小。即使暴富了的,也有幸存者偏差在,只要沒有離開市場,說不定哪天還會踩雷.

1900/1/1 0:00:00本報記者鄭瑜張榮旺北京報道隨著中國人民銀行開展數字貨幣研發工作的深入,數字貨幣、區塊鏈成為上市公司眼中的香餑餑.

1900/1/1 0:00:00在對一畝田APP移動端進行深入細致的使用和產品體驗之后,本文我將基于產品視角,從產品戰略層、戰術層、框架層、功能層、表現層等五個方面來做從整體到局部的產品邏輯分析,并在分析的基礎上.

1900/1/1 0:00:00Amber報告:仍然認為加密貨幣將走勢強勁Amber報告稱,我們密切關注著不斷變化的宏觀經濟走勢,以及世界各國政府相繼實施的貨幣政策和財政政策.

1900/1/1 0:00:00